Zwischen Blickregime und Bewertungslogik

Patriarchalische Strukturen wirken oft nicht laut, sondern über Bilder, Haltungen und Erwartungen. Sie bestimmen, wer als attraktiv, souverän oder sichtbar gilt – und nach welchen Maßstäben ein Körper gelesen wird. Besonders deutlich wird das in asymmetrischen Schönheitsidealen: Während Reife, Markanz und sichtbares Altern bei Männern häufig als charismatisch oder würdevoll inszeniert werden, werden ähnliche Merkmale bei Frauen noch immer strenger bewertet, kaschiert oder abgewertet. Dazu im folgenden ein kurzes Experiment mit KI-generierten Bildern.

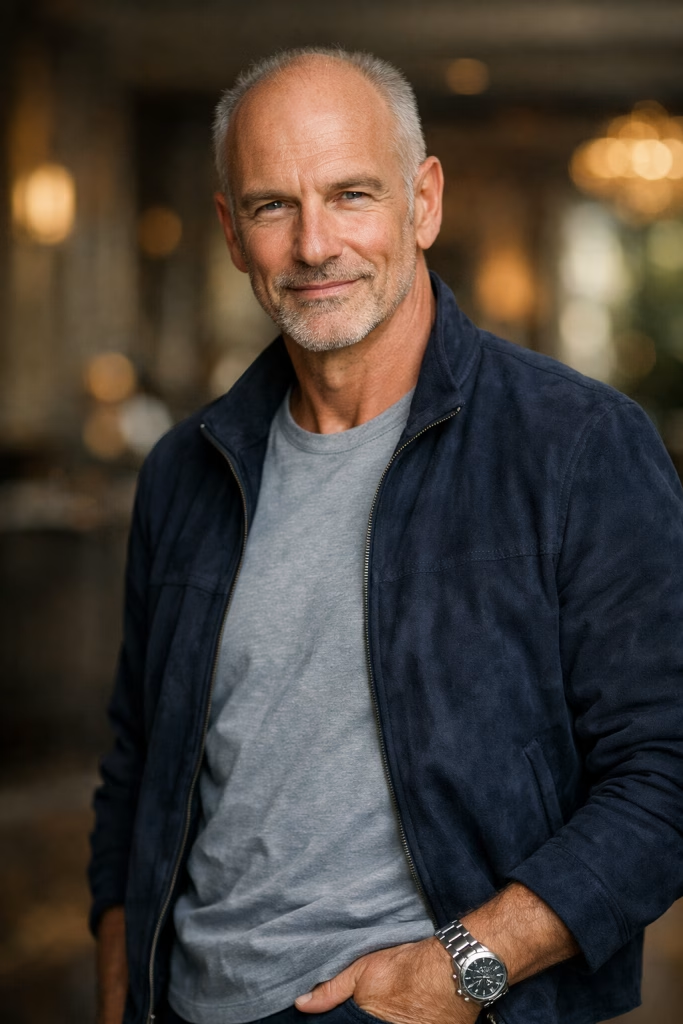

Mann um die 60

Das erste Porträt zeigt, wie selbstverständlich männliche Präsenz mit Selbstbewusstsein, Erfahrung und Attraktivität verknüpft wird. Dünner werdendes Haar, markante Gesichtszüge und Alter erscheinen nicht als Makel, sondern als Zeichen von Persönlichkeit. Das Bild folgt damit einer visuellen Ordnung, die Männer großzügiger behandelt – und ihnen erlaubt, jenseits jugendlicher Perfektion als begehrenswert zu gelten.

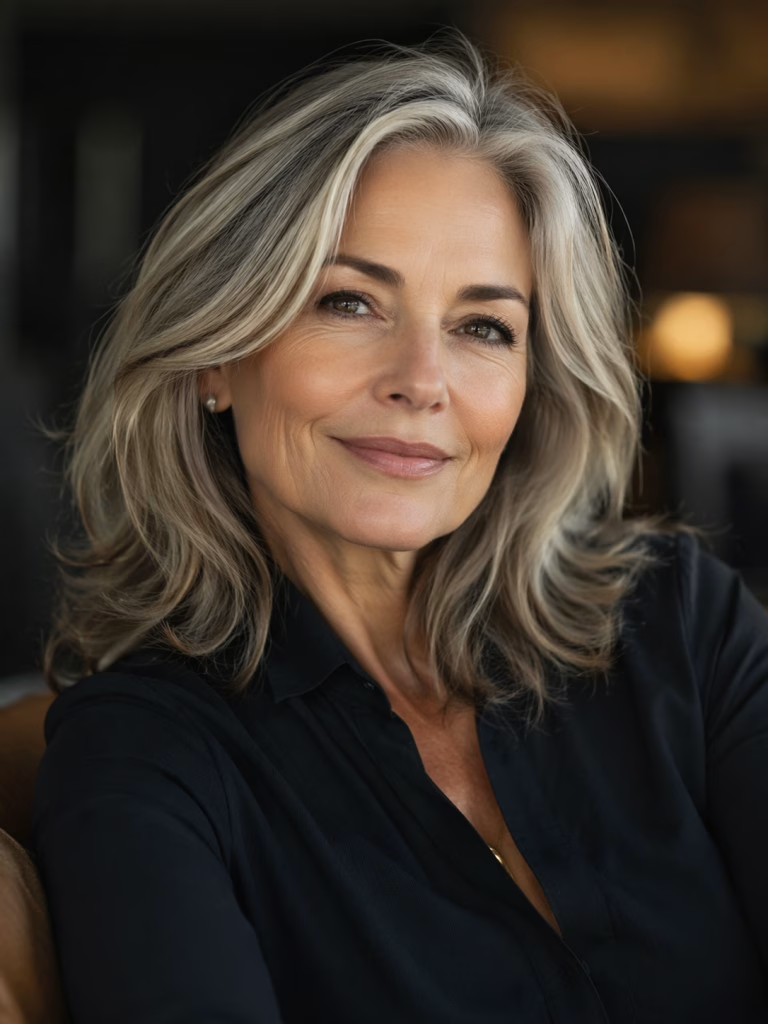

Das genaue KI Pendant: Frau um die 60

Im zweite Bild verschiebt sich dieselbe ästhetische Ausgangslage auf eine Frau – und genau darin liegt die Reibung. Plötzlich werden dieselben Merkmale anders gelesen. Wo beim Mann Reife und Lässigkeit mitschwingen, steht bei der Frau sofort die kulturell angelernte Frage im Raum, ob sie noch den Erwartungen an Weiblichkeit entspricht. Diese Ungleichheit ist kein individuelles Empfinden, sondern Ausdruck eines patriarchalen Blicks, der Frauenkörper enger normiert, stärker diszipliniert und konsequenter bewertet.

Kritische Bildarbeit kann solche Muster sichtbar machen. Nicht, indem sie neue Ideale schafft, sondern indem sie die alten offenlegt: die doppelten Standards, die asymmetrische Toleranz gegenüber dem Altern und die tief verankerte Vorstellung, dass Weiblichkeit vor allem gefallen müsse. Gerade dort, wo zwei ähnliche Bildideen so unterschiedlich gelesen werden, wird die Struktur dahinter erkennbar.

Solange Alter bei Männern als Würde und bei Frauen als Verlust gelesen wird, bleibt Schönheit kein neutrales Ideal, sondern ein Machtinstrument.

Addendum

Es ist erstaunlich schwer, einer generativen KI ein wirklich gleichwertiges weibliches Pendant zu solchen männlichen Bildmotiven wie dem ersten Porträt beizubringen. Schon ein scheinbar neutraler Prompt wie „das gleiche Bild, aber der Mann ist jetzt eine Frau“ führt nicht zu einer echten Übertragung derselben Bildidee. Stattdessen ergibt sich eine Verschiebung in Richtung glatterer, gefälligerer und normschöner Weiblichkeit. Statt derselben Reife, Strenge oder Ambivalenz erscheint plötzlich ein deutlich konventionelleres, attraktiver gemachtes Frauenbild.

Gerade darin zeigt sich, wie tief patriarchale Normen nicht nur in uns und der Gesellschaft, sondern auch in solchen Systemen verankert sind. Die KI reproduziert nicht einfach nur Geschlecht, sondern kulturell eingelernte Erwartungen daran, wie Weiblichkeit auszusehen hat: jugendlicher, weicher, harmonischer, gefälliger. Was technisch wie eine kleine Variation wirkt, ist in Wahrheit ein aufschlussreicher Bias. Selbst dort, wo Gleichheit im Prompt steht, erzeugt das System wieder die alte Hierarchie im Bild.

P.S.: Auch dass die abgebildeten Menschen durchweg nicht als POC erscheinen, ist keineswegs zufällig. Darin zeigt sich ein weiterer, tief verankerter Bias generativer KI. Auch auf der Ebene von Hautfarbe, Gesichtszügen und visueller Norm setzt sie häufig weiße Erscheinungsbilder als stillschweigenden Standard. In diesem Fall ist das nicht nur eine Verzerrung, sondern Ausdruck eines rassistischen Musters. Gesellschaftliche Machtverhältnisse werden im Bild erneut reproduziert.

Schreibe einen Kommentar